目录

一、方案对比

方案1:使用飞牛自带的 ollama 套件

| 优点 | 缺点 |

|---|---|

| ollama + openwebui 组合套件,安装简单 | 版本较低,无法使用 qwen3.5 等新模型 |

结论:测试多次后,直接更新存在风险,怕弄崩系统,故卸载等待飞牛官方更新,目前飞牛官方已经更新,可以正常使用了。

方案2:使用 Docker 安装 ollama + 飞牛市场 lobechat

- lobechat 可直接通过飞牛市场安装

- 配置方式:在设置中找到 ollama,打开右侧开关,点击模型框下方文字即可搜索 ollama 模型

- 缺点:版本过低,最新版暂未找到安装源

方案3:使用 Docker 安装 ollama + openwebui(推荐方案,下面详细介绍此方法安装)

二、具体操作步骤

步骤一:下载镜像

1. ollama 镜像

打开飞牛 Docker,在镜像仓库搜索 ollama,选择第一个 ollama/ollama(官方源),点击右侧下载。默认 latest 即为最新版,下载速度可能较慢。

2. openwebui 镜像

openwebui 在镜像仓库中无官方源,需在本地镜像 → 添加镜像中添加下载链接:

- 地址:

ghcr.io/open-webui/open-webui:main - 账号密码留空,点击确认等待下载(同样较慢)

步骤二:配置 ollama 容器

点击 ollama 镜像右侧箭头,创建容器:

| 配置项 | 设置值 | 说明 |

|---|---|---|

| 开机自动启动 | ✅ 勾选 | – |

| 端口 | 11434 |

确保未被占用 |

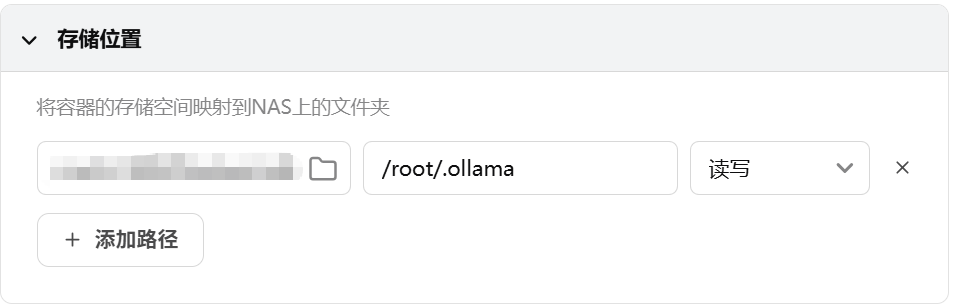

| 存储路径 | 自定义路径 →/root/.ollama/ |

建议选大容量磁盘 |

| 网络模式 | host |

– |

环境变量配置:

|

1 2 3 |

OLLAMA_ORIGINS=* (必填) OLLAMA_VULKAN=1 (启用 Vulkan) |

功能选择:

选择高权限容器。

步骤三:配置 openwebui 容器

| 配置项 | 设置值 |

|---|---|

| 端口 | 3000:8080 |

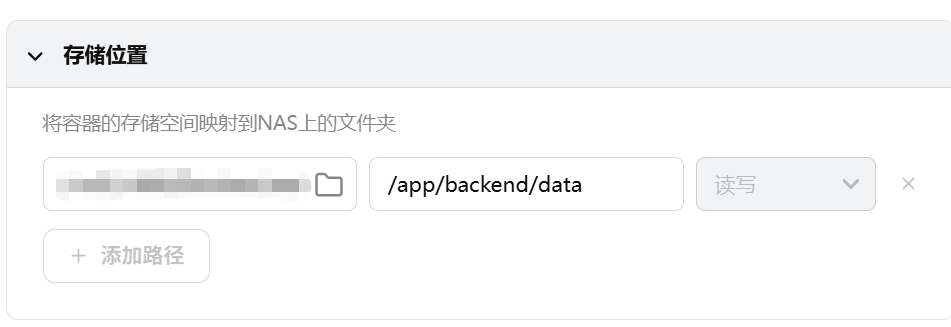

| 存储路径 | 同 ollama 配置 |

| 网络模式 | bridge |

存储路径如下:和ollama一样,前面是选择的存放地点,后面如下

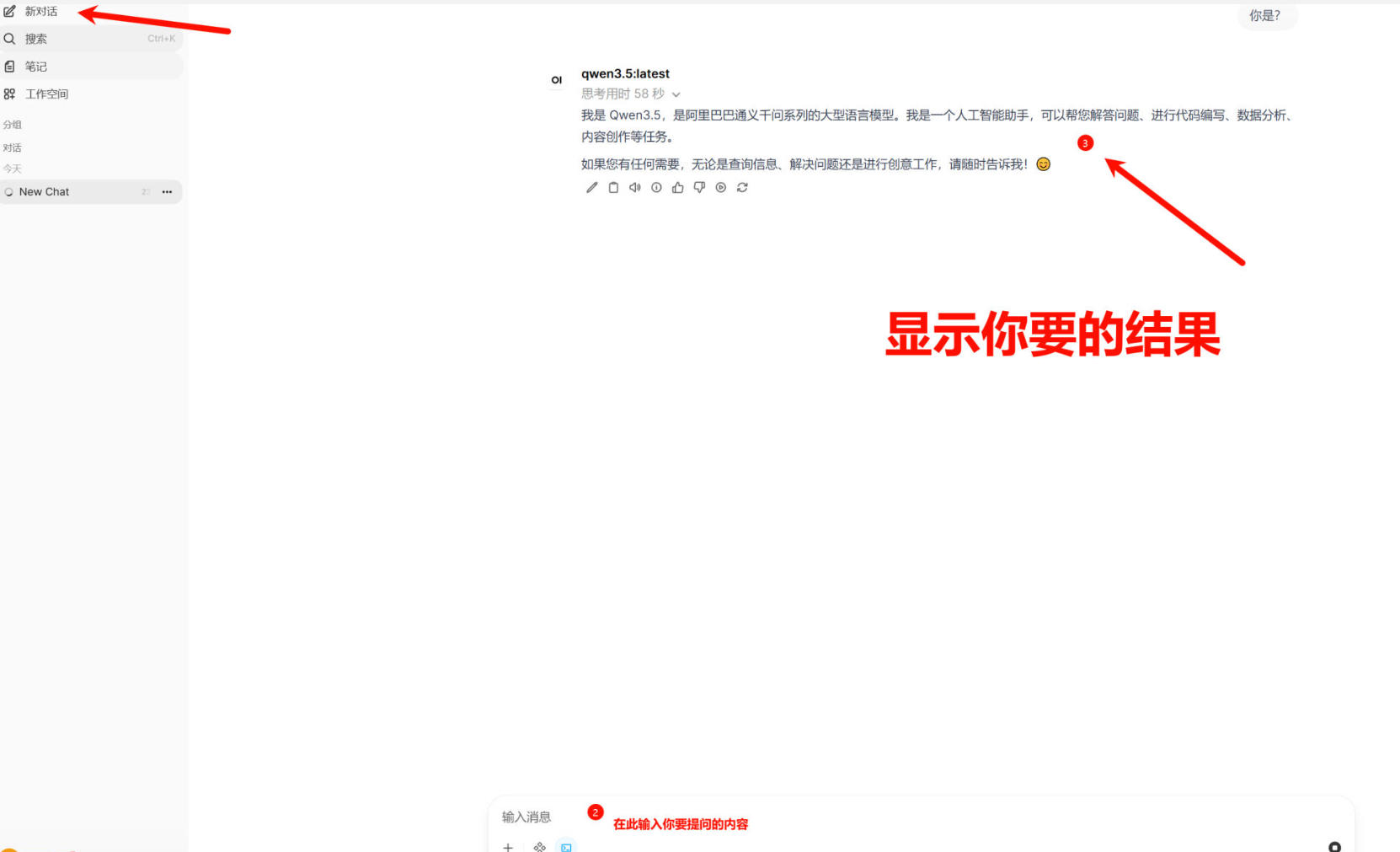

四:使用

如果是局域网使用,直接在飞牛地址后面加上:3000就行了。就会打开这个openwebui,如果要是fnconnect的话要点开docker》容器点箭头的位置,会有一个3000:8080的下拉框,点击一下就行。

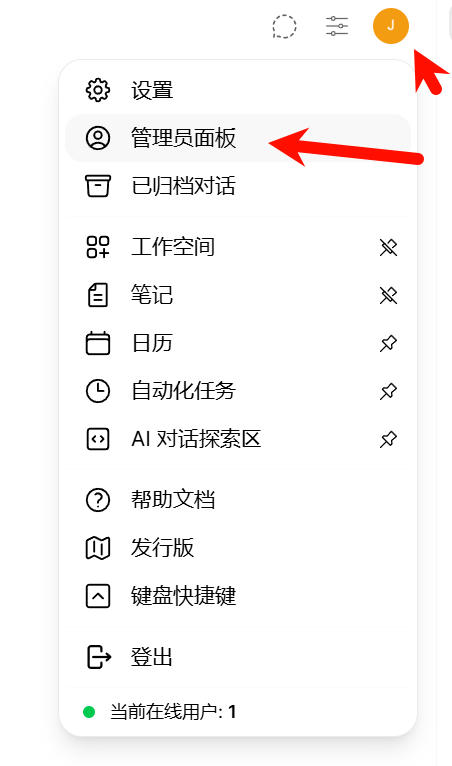

点击右上角的设置管理员面板设置:

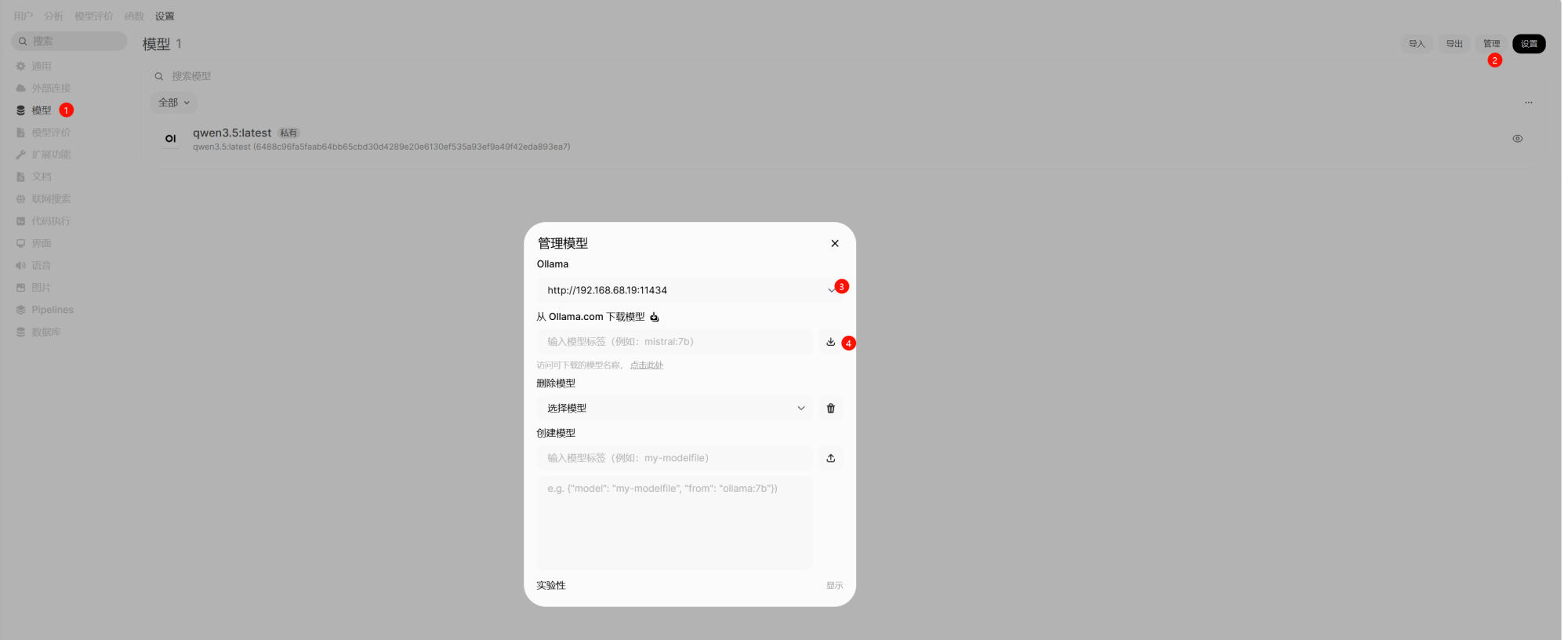

填上刚才安装好的ollama地址:

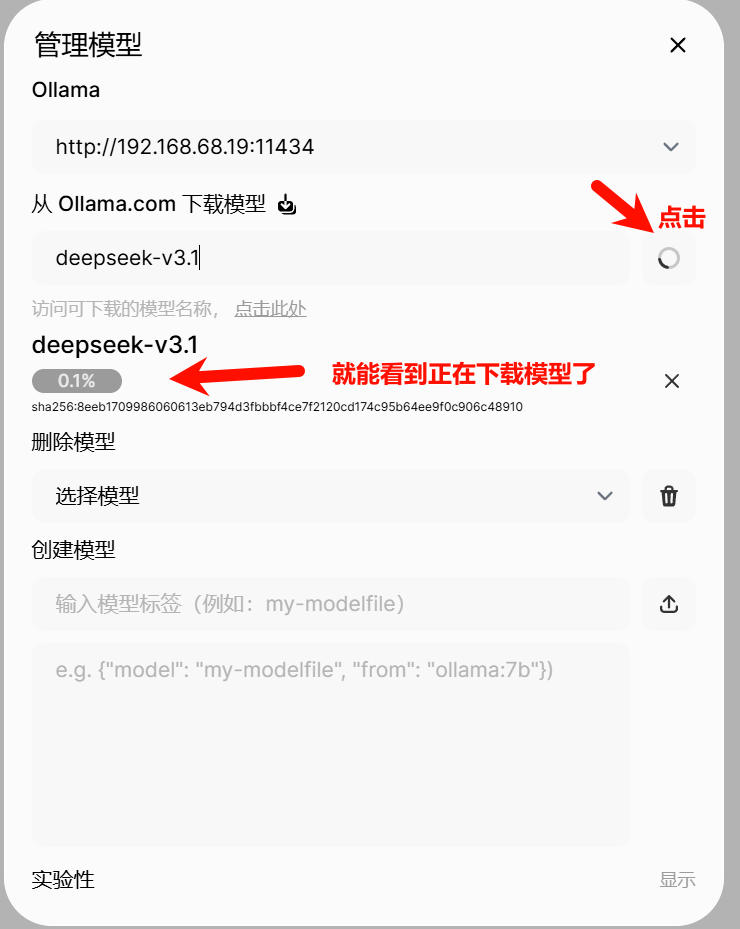

开始安装模型,管理-ollama选择刚安装的地址,第四步输入模型名称就能查找安装了,模型名称可以在这打开:https://ollama.com/library 查看,例如输入:deepseek-r1

到这里你已经成功搭建一个开源免费的AI系统,愉快的去玩爽吧!!!!!

创作不易,用心坚持,请喝一怀爱心咖啡!继续坚持创作~~